モリカトロン株式会社運営「エンターテインメント×AI」の最新情報をお届けするサイトです。

- TAG LIST

- CGCGへの扉安藤幸央生成AI月刊エンタメAIニュース機械学習河合律子ディープラーニング吉本幸記OpenAIGAN音楽NVIDIAChatGPTGoogle強化学習三宅陽一郎森川幸人グーグルStable Diffusionニューラルネットワーク大規模言語モデルLLMシナリオDeepMind人工知能学会モリカトロンマイクロソフトQAAIと倫理GPT-3自然言語処理Facebook大内孝子倫理映画著作権ルールベースアートゲームプレイAIキャラクターAIスクウェア・エニックス敵対的生成ネットワークSIGGRAPHモリカトロンAIラボインタビューNPC画像生成NFTMinecraftロボットDALL-E2音楽生成AIプロシージャルMidjourneyデバッグファッションStyleGAN自動生成ディープフェイク遺伝的アルゴリズム画像生成AIゲームAIVFXAdobeテストプレイメタAIアニメーションテキスト画像生成深層学習CEDEC2019MicrosoftデジタルツインメタバースVR小説ボードゲームDALL-ECLIPtoioビヘイビア・ツリーマンガCEDEC2021CEDEC2020作曲不完全情報ゲームロボティクスナビゲーションAIマインクラフト畳み込みニューラルネットワークスポーツエージェントGDC 2021GPT-4手塚治虫マルチモーダル汎用人工知能JSAI2022バーチャルヒューマンNVIDIA OmniverseGDC 2019動画生成AIマルチエージェントCEDEC2022MetaAIアート3DCGStability AIメタデジタルヒューマン懐ゲーから辿るゲームAI技術史教育ジェネレーティブAIはこだて未来大学プロンプトRed Ram栗原聡CNNNeRFDALL-E 3BERTMicrosoft AzureUnityOmniverseJSAI2023ELSI鴫原盛之HTN階層型タスクネットワークソニー東京大学JSAI2020GTC20233DマーケティングTensorFlowインタビューブロックチェーンCMイベントレポートアストロノーカ模倣学習対話型エージェントAmazonトレーディングカードメディアアートDQN高橋力斗合成音声水野勇太アバターブラック・ジャックUbisoftGenvid TechnologiesガイスターStyleGAN2電気通信大学稲葉通将ARアップルGTC2022GPT-3.5SoraSIGGRAPH ASIANetflixJSAI2021Bard研究シムピープル世界モデルMCS-AI動的連携モデルマーダーミステリーモーションキャプチャーアドベンチャーゲームTEZUKA2020CEDEC2023AGIテキスト生成インディーゲームElectronic Arts音声合成広告JSAI2024メタデータGDC Summerイーロン・マスクStable Diffusion XL森山和道キャリアeスポーツスタンフォード大学アーケードゲームテニスサイバーエージェント音声認識類家利直eSportsBLUE PROTOCOLシーマンaiboSIE大澤博隆SFプロトタイピングモリカトロン開発者インタビュー宮本茂則チャットボットGeminiワークショップEpic GamesAIロボ「迷キュー」に挑戦AWS徳井直生村井源クラウド斎藤由多加AlphaZeroTransformerGPT-2rinnaAIりんなカメラ環世界中島秀之PaLMGitHub Copilot哲学ベリサーブPlayable!ハリウッド理化学研究所Gen-1SFテキスト画像生成AI松尾豊AIQVE ONEデータマイニング現代アートDARPAドローンシムシティゲームエンジンImagenZorkバイアスASBSぱいどんAI美空ひばり手塚眞バンダイナムコ研究所スパーシャルAIELYZANEDOFSM-DNNMindAgentLEFT 4 DEAD通しプレイ論文OpenAI Five本間翔太馬淵浩希CygamesAudio2Faceピクサープラチナエッグイーサリアム効果音ボエダ・ゴティエビッグデータ中嶋謙互Amadeus Codeデータ分析MILENVIDIA ACEナラティブNVIDIA RivaOmniverse ReplicatorWCCFレコメンドシステムNVIDIA DRIVE SimWORLD CLUB Champion FootballNVIDIA Isaac Simセガ柏田知大軍事田邊雅彦Google I/Oトレカ慶應義塾大学Max CooperGPTDisneyFireflyPyTorch京都芸術大学ChatGPT4モンテカルロ木探索眞鍋和子バンダイナムコスタジオヒストリアAI Frog Interactive新清士田中章愛銭起揚齊藤陽介コナミデジタルエンタテインメント成沢理恵お知らせMagic Leap OneTencentサッカーバスケットボールTikTokSuno AItext-to-imageサルでもわかる人工知能text-to-3DVAEDreamFusionTEZUKA2023リップシンキングRNNUbisoft La Forge自動運転車知識表現ウォッチドッグス レギオンVTuberIGDA立教大学秋期GTC2022市場分析フォートナイトKLabどうぶつしょうぎRobloxジェイ・コウガミ音楽ストリーミングMIT野々下裕子Adobe MAXマシンラーニング5GMuZeroRival Peakがんばれ森川君2号pixivオムロン サイニックエックスGPTs対話エンジンポケモン3Dスキャン橋本敦史リトル・コンピュータ・ピープルCodexシーマン人工知能研究所コンピューティショナル・フォトグラフィーPreferred Networksゴブレット・ゴブラーズ絵画Open AI3D Gaussian SplattingMicrosoft DesignerイラストシミュレーションSoul Machines柿沼太一完全情報ゲームバーチャルキャラクター坂本洋典宮本道人釜屋憲彦ウェイポイントLLaMAパス検索Hugging Face対談藤澤仁生物学GTC 2022xAIApple Vision Pro画像認識SiemensストライキStyleCLIPDeNAVoyager長谷洋平GDC 2024クラウドコンピューティングmasumi toyotaIBM宮路洋一OpenSeaGDC 2022SNSTextWorldEarth-2AppleBingMagentaソフトバンクYouTube音声生成AIELYZA PencilScenarioSIGGRAPH2023AIピカソGTC2021AI素材.comCycleGANテンセントAndreessen HorowitzQA Tech Night松木晋祐NetHack下田純也桑野範久キャラクターモーションControlNet音源分離NBAフェイクニュースユニバーサルミュージックRPG法律Web3SIGGRAPH 2022レベルデザインDreamerV3AIボイスアクターUnreal Engine南カリフォルニア大学NVIDIA CanvasGPUALife人工生命オルタナティヴ・マシンサム・アルトマンサウンドスケープLaMDATRPGマジック:ザ・ギャザリングAI Dungeon介護ゲーム背景アパレル不気味の谷ナビゲーションメッシュデザイン写真高橋ミレイ深層強化学習松原仁松井俊浩武田英明フルコトELYZA DIGESTWWDCWWDC 2024建築西成活裕ハイブリッドアーキテクチャAI野々村真Apex LegendsELIZA群衆マネジメントライブポートレイトNinjaコンピュータRPGライブビジネスWonder StudioAdobe Max 2023GPT-4-turboアップルタウン物語新型コロナ土木佐藤恵助KELDIC周済涛BIMBing Chat大道麻由メロディ言語清田陽司インフラBing Image Creator物語構造分析ゲームTENTUPLAYサイバネティックス慶応義塾大学MARVEL Future FightAstro人工知能史Amazon BedrockAssistant with Bard渡邉謙吾タイムラプスEgo4DAI哲学マップThe Arcadeここ掘れ!プッカバスキア星新一X.AISearch Generative Experienceくまうた日経イノベーション・ラボStyleGAN-XLX Corp.Dynalang濱田直希敵対的強化学習StyleGAN3TwitterVLE-CE大柳裕⼠階層型強化学習GOSU Data LabGANimatorXホールディングス加納基晴WANNGOSU Voice AssistantVoLux-GANMagiAI Actソニー・インタラクティブエンタテインメント竹内将SenpAI.GGProjected GANEU研究開発事例MobalyticsSelf-Distilled StyleGANSDXLArs Electronica赤羽進亮ニューラルレンダリングRTFKTAI規制遊戯王岡島学AWS SagemakerPLATONIKE欧州委員会UDI(Universal Duel Interface)映像セリア・ホデント形態素解析frame.ioClone X欧州議会第一工科大学UXAWS LambdaFoodly村上隆欧州理事会佐竹空良誤字検出MusicLM小林篤史認知科学中川友紀子Digital MarkAudioLM九州大学ゲームデザインSentencePieceアールティSnapchatMusicCaps荻野宏実LUMINOUS ENGINEクリエイターコミュニティAudioCraft伊藤黎Luminous ProductionsBlenderBot 3バーチャルペットビヘイビアブランチパターン・ランゲージ竹村也哉Meta AINVIDIA NeMo ServiceMubertWPPちょまどマーク・ザッカーバーグヴァネッサ・ローザMubert RenderGeneral Computer Control(GCC)GOAPWACULVanessa A RosaGen-2CradleAdobe MAX 2021陶芸Runway AI Film Festival自動翻訳Play.htPreViz音声AIAIライティングLiDARCharacter-LLMOmniverse AvatarAIのべりすとPolycam復旦大学FPSQuillBotdeforumChat-Haruhi-Suzumiyaマルコフ決定過程NVIDIA MegatronCopysmith涼宮ハルヒNVIDIA MerlinJasperハーベストEmu VideoNVIDIA MetropolisForGamesNianticパラメータ設計ゲームマーケットペリドットバランス調整岡野翔太Dream Track協調フィルタリング郡山喜彦Music AI Tools人狼知能テキサス大学ジェフリー・ヒントンLyriaGoogle I/O 2023Yahoo!知恵袋AlphaDogfight TrialsAI Messenger VoicebotインタラクティブプロンプトAIエージェントシミュレーションOpenAI Codex武蔵野美術大学StarCraft IIHyperStyleBingAI石渡正人Future of Life InstituteRendering with Style手塚プロダクションIntel林海象LAIKADisneyリサーチヴィトゲンシュタインPhotoshop古川善規RotomationGauGAN論理哲学論考Lightroom大規模再構成モデルGauGAN2CanvaLRMドラゴンクエストライバルズ画像言語表現モデルObjaverse不確定ゲームSIGGRAPH ASIA 2021PromptBaseBOOTHMVImgNetDota 2ディズニーリサーチpixivFANBOXOne-2-3-45Mitsuba2バンダイナムコネクサス虎の穴3DガウシアンスプラッティングソーシャルゲームEmbeddingワイツマン科学研究所ユーザーレビューFantiaワンショット3D生成技術GTC2020CG衣装mimicとらのあなNVIDIA MAXINEVRファッションBaidu集英社FGDC淡路滋ビデオ会議ArtflowERNIE-ViLG少年ジャンプ+Future Game Development ConferenceグリムノーツEponym古文書ComicCopilot佐々木瞬ゴティエ・ボエダ音声クローニング凸版印刷コミコパGautier Boeda階層的クラスタリングGopherAI-OCRゲームマスター画像判定Inowrld AIJulius鑑定ラベル付けMODAniqueTPRGOxia PalusGhostwriter中村太一バーチャル・ヒューマン・エージェントtoio SDK for UnityArt RecognitionSkyrimエグゼリオクーガー実況パワフルサッカースカイリムCopilot石井敦NHC 2021桃太郎電鉄RPGツクールMZComfyUI茂谷保伯池田利夫桃鉄ChatGPT_APIMZserial experiments lainGDMC新刊案内パワサカダンジョンズ&ドラゴンズAI lainマーベル・シネマティック・ユニバースOracle RPGPCGMITメディアラボMCU岩倉宏介深津貴之PCGRLアベンジャーズPPOxVASynthDungeons&Dragonsマジック・リープDigital DomainMachine Learning Project CanvasLaser-NVビートルズMagendaMasquerade2.0国立情報学研究所ザ・ビートルズ: Get BackノンファンジブルトークンDDSPフェイシャルキャプチャー石川冬樹MERFDemucsスパコンAlibaba音楽編集ソフト里井大輝KaggleスーパーコンピュータVQRFAdobe Audition山田暉松岡 聡nvdiffreciZotopeAssassin’s Creed OriginsAI会話ジェネレーターTSUBAME 1.0NeRFMeshingRX10Sea of ThievesTSUBAME 2.0LERFMoisesGEMS COMPANYmonoAI technologyLSTMABCIマスタリングモリカトロンAIソリューション富岳レベルファイブ初音ミクOculusコード生成AISociety 5.0リアム・ギャラガー転移学習テストAlphaCode夏の電脳甲子園グライムスKaKa CreationBaldur's Gate 3Codeforces座談会BoomyVOICEVOXCandy Crush Saga自己増強型AIジョン・レジェンドGenie AISIGGRAPH ASIA 2020COLMAPザ・ウィークエンドSIGGRAPH Asia 2023ADOPNVIDIA GET3DドレイクC·ASEデバッギングBigGANGANverse3DFLAREMaterialGANダンスグランツーリスモSPORTAI絵師エッジワークスMagicAnimateReBeLグランツーリスモ・ソフィーUGC日本音楽作家団体協議会Animate AnyoneGTソフィーPGCFCAインテリジェントコンピュータ研究所VolvoFIAグランツーリスモチャンピオンシップVoiceboxアリババNovelAIさくらインターネットDreaMovingRival PrakDGX A100NovelAI DiffusionVISCUITぷよぷよScratchユービーアイソフトWebcam VTuberモーションデータスクラッチ星新一賞大阪公立大学ビスケット北尾まどかHALOポーズ推定TCGプログラミング教育将棋メタルギアソリッドVメッシュ生成FSMメルセデス・ベンツQRコードVALL-EMagic Leap囲碁Deepdub.aiナップサック問題Live NationEpyllionデンソーAUDIOGEN汎用言語モデルWeb3.0マシュー・ボールデンソーウェーブEvoke MusicAIOpsムーアの法則原昌宏AutoFoleySpotifyスマートコントラクト日本機械学会Colourlab.AiReplica Studioロボティクス・メカトロニクス講演会ディズニーamuseChitrakarQosmoAdobe MAX 2022トヨタ自動車Largo.ai巡回セールスマン問題かんばん方式Cinelyticジョルダン曲線メディアAdobe ResearchTaskade政治Galacticaプロット生成Pika.artクラウドゲーミングAI Filmmaking Assistant和田洋一リアリティ番組映像解析FastGANStadiaジョンソン裕子セキュリティ4コママンガAI ScreenwriterMILEsNightCafe東芝デジタルソリューションズ芥川賞インタラクティブ・ストリーミングLuis RuizSATLYS 映像解析AI文学インタラクティブ・メディア恋愛PFN 3D ScanElevenLabsタップル東京工業大学HeyGenAbema TVLudo博報堂After EffectsNECラップPFN 4D Scan絵本木村屋SIGGRAPH 2019ArtEmisZ世代DreamUp出版GPT StoreAIラッパーシステムDeviantArtAmmaar Reshi生成AIチェッカーWaifu DiffusionStoriesユーザーローカルGROVERプラスリンクス ~キミと繋がる想い~元素法典StoryBird九段理江FAIRSTCNovel AIVersed東京都同情塔チート検出Style Transfer ConversationProlificDreamerオンラインカジノRCPUnity Sentis4Dオブジェクト生成モデルRealFlowRinna Character PlatformUnity MuseAlign Your GaussiansiPhoneCALACaleb WardAYGDeep Fluids宮田龍MAV3DMeInGameAmelia清河幸子ファーウェイAIGraphブレイン・コンピュータ・インタフェース西中美和4D Gaussian SplattingBCIGateboxアフォーダンス安野貴博4D-GSLearning from VideoANIMAKPaLM-SayCan斧田小夜Glaze予期知能逢妻ヒカリWebGlazeセコムLLaMA 2NightShadeユクスキュルバーチャル警備システムCode as PoliciesSpawningカント損保ジャパンCaPHave I Been Trained?CM3leonFortnite上原利之Stable DoodleUnreal Editor For FortniteドラゴンクエストエージェントアーキテクチャアッパーグラウンドコリジョンチェックT2I-AdapterXRPAIROCTOPATH TRAVELER西木康智VolumetricsOCTOPATH TRAVELER 大陸の覇者山口情報芸術センター[YCAM]AIワールドジェネレーターアルスエレクトロニカ2019品質保証YCAM日本マネジメント総合研究所Rosebud AI GamemakerStyleRigAutodeskアンラーニング・ランゲージLayer逆転オセロニアBentley Systemsカイル・マクドナルドLily Hughes-RobinsonCharisma.aiワールドシミュレーターローレン・リー・マッカーシーColossal Cave Adventure奥村エルネスト純いただきストリートH100鎖国[Walled Garden]プロジェクトAdventureGPT調査齋藤精一大森田不可止COBOLSIGGRAPH ASIA 2022リリー・ヒューズ=ロビンソンMeta Quest高橋智隆DGX H100VToonifyBabyAGIIPロボユニザナックDGX SuperPODControlVAEGPT-3.5 Turbo泉幸典仁井谷正充変分オートエンコーダーカーリング強いAIロボコレ2019Instant NeRFフォトグラメトリウィンブルドン弱いAIartonomous回帰型ニューラルネットワークbitGANsDeepJoin戦術分析ぎゅわんぶらあ自己中心派Azure Machine LearningAzure OpenAI Serviceパフォーマンス測定Lumiere意思決定モデル脱出ゲームDeepLIoTUNetHybrid Reward Architectureコミュニティ管理DeepL WriteProFitXImageFXウロチョロスSuper PhoenixWatsonxMusicFXProject MalmoオンラインゲームAthleticaTextFX気候変動コーチングProject Paidiaシンギュラリティ北見工業大学KeyframerProject Lookoutマックス・プランク気象研究所レイ・カーツワイル北見カーリングホールWatch Forビョルン・スティーブンスヴァーナー・ヴィンジ画像解析Gemini 1.5気象モデルRunway ResearchじりつくんAI StudioLEFT ALIVE気象シミュレーションMake-A-VideoNTT SportictVertex AI長谷川誠ジミ・ヘンドリックス環境問題PhenakiAIカメラChat with RTXBaby Xカート・コバーンエコロジーDreamixSTADIUM TUBESlackロバート・ダウニー・Jr.エイミー・ワインハウスSDGsText-to-ImageモデルPixelllot S3Slack AIPokémon Battle Scopeダフト・パンクメモリスタAIスマートコーチポケットモンスターGlenn MarshallkanaeruThe Age of A.I.Story2Hallucination音声変換Latitude占いレコメンデーションJukeboxDreambooth行動ロジック生成AIVeap Japanヤン・ルカンConvaiEAPneoAIPerfusionNTTドコモSIFT福井千春DreamIconニューラル物理学EmemeDCGAN医療mign毛髪GenieMOBADANNCEメンタルケアstudiffuse荒牧英治汎用AIエージェント人事ハーバード大学Edgar Handy中ザワヒデキAIファッションウィーク研修デューク大学大屋雄裕インフルエンサー中川裕志Grok-1mynet.aiローグライクゲームAdreeseen HorowitzMixture-of-Experts東京理科大学NVIDIA Avatar Cloud EngineMoE人工音声NeurIPS 2021産業技術総合研究所Replica StudiosClaude 3リザバーコンピューティングSmart NPCsClaude 3 Haikuプレイ動画ヒップホップ対話型AIモデルRoblox StudioClaude 3 Sonnet詩ソニーマーケティングPromethean AIClaude 3 Opusサイレント映画もじぱnote森永乳業環境音暗号通貨note AIアシスタントMusiioC2PAFUZZLEKetchupEndelゲーミフィケーションAlterationAI NewsTomo Kihara粒子群最適化法Art SelfiePlayfool進化差分法オープンワールドArt TransferSonar遊び群知能下川大樹AIFAPet PortraitsSonar+Dtsukurunウィル・ライト高津芳希P2EBlob Opera地方創生大石真史クリムトDolby Atmos吉田直樹BEiTStyleGAN-NADASonar Music Festival素材DETRライゾマティクスSIMASporeクリティックネットワーク真鍋大度OpenAI JapanデノイズUnity for Industryアクターネットワーク花井裕也Voice Engine画像処理DMLabRitchie HawtinCommand R+SentropyGLIDEControl SuiteErica SynthOracle Cloud InfrastructureCPUDiscordAvatarCLIPAtari 100kUfuk Barış MutluGoogle WorkspaceSynthetic DataAtari 200MJapanese InstructBLIP AlphaUdioCALMYann LeCun日本新聞協会立命館大学プログラミング鈴木雅大AIいらすとや京都精華大学ソースコード生成コンセプトアートAI PicassoTacticAIGMAIシチズンデベロッパーSonanticColie WertzEmposyNPMPGitHubCohereリドリー・スコットAIタレントFOOHウィザードリィMCN-AI連携モデル絵コンテAIタレントエージェンシーGPT-4oUrzas.aiストーリーボードmodi.aiProject Astra大阪大学BitSummitGoogle I/O 2024西川善司並木幸介KikiBlenderBitSummit Let’s Go!!Gemma 2サムライスピリッツ森寅嘉Zoetic AIVeoゼビウスSIGGRAPH 2021ペット感情認識ストリートファイター半導体Digital Dream LabsPaLM APIデジタルレプリカ音声加工Topaz Video Enhance AICozmoMakerSuiteGOT7マルタ大学DLSSタカラトミーSkebsynthesia田中達大山野辺一記NetEaseLOVOTDreambooth-Stable-DiffusionHumanRFInworld AI大里飛鳥DynamixyzMOFLINActors-HQMove AIRomiGoogle EarthSAG-AFTRAICRA2024U-NetミクシィGEPPETTO AIWGAIEEE13フェイズ構造ユニロボットStable Diffusion web UIチャーリー・ブルッカー大規模基盤モデルADVユニボPoint-EToroboXLandGato岡野原大輔東京ロボティクスAI model自己教師あり学習インピーダンス制御DEATH STRANDINGAI ModelsIn-Context Learning(ICL)深層予測学習Eric Johnson汎用強化学習AIZMO.AILoRA日立製作所MOBBY’Sファインチューニング早稲田大学Oculus Questコジマプロダクションロンドン芸術大学モビーディックグランツーリスモ尾形哲也生体情報デシマエンジンGoogle Brainダイビング量子コンピュータAIRECSound Controlアウトドアqubit汎用ロボットSYNTH SUPERAIスキャニングIBM Quantum System 2オムロンサイニックエックス照明Maxim PeterKarl Sims自動採寸北野宏明ViLaInJoshua RomoffArtnome3DLOOKダリオ・ヒルPDDLハイパースケープICONATESizerジェン・スン・フアンニューサウスウェールズ大学山崎陽斗ワコールHuggingFaceClaude Sammut立木創太スニーカーStable Audioオックスフォード大学浜中雅俊UNSTREET宗教Lars Kunzeミライ小町Newelse仏教杉浦孔明テスラ福井健策CheckGoodsコカ・コーラ田向権GameGAN二次流通食品VASA-1パックマンTesla Bot中古市場Coca‑Cola Y3000 Zero SugarVoxCeleb2Tesla AI DayWikipediaDupe KillerCopilot Copyright CommitmentAniTalkerソサエティ5.0Sphere偽ブランドテラバース上海大学SIGGRAPH 2020バズグラフXaver 1000配信京都大学Apple Intelligenceニュースタンテキ養蜂立福寛東芝Beewiseソニー・ピクチャーズ アニメーション音声解析DIB-R倉田宜典フィンテック感情分析Luma投資Fosters+Partners周 済涛Dream Machine韻律射影MILIZEZaha Hadid ArchitectsステートマシンNTT韻律転移三菱UFJ信託銀行ディープニューラルネットワークPerplexity

【GDC 2019】没入感の追求がたどり着く先は、自然言語処理によるAIとの対話

アップルのSiriやマイクロソフトのCortana、アマゾンのAlexaといったAIアシスタントがスマートフォンやスマートスピーカーとして人々の日常に溶け込んだ今、音声認識という技術も人工知能と同様に身近な存在となりました。その中枢をなしている研究分野が自然言語処理です。

中でもコンピュータに自然言語を理解、もしくは意図を抽出させることを目的とした自然言語理解は、音声アクティベーションやコンテンツ解析、ニュース収集といった商業的な関心が高まる一方で、コンピュータビジョンやチューリングテストと並ぶAI完全問題であると言われています。

それでもアプリや家電を起動させたり、ニュース記事を音声出力で読み上げるといった技術的に限られた条件下では、少しずつではありますが自然言語理解が実用化されつつあります。一方でグラフィック処理技術の発展にともない、没入感という言葉が定着したVR/AR/MRの領域もふくむビデオゲームにおける、音声認識に基づいたインターフェイスの開発は意外にも進んでいませんでした。

音声認識を使ったゲームの歴史と技術的な限界

本格的に音声認識がゲームソフトに組み込まれた最初の例は、1998年の年末にNINTENDO64向けに発売された『ピカチュウげんきでちゅう』(1998年、任天堂)です。ヘッドセット型のマイクを使ってプレイヤーがピカチュウと意思疎通できる世界初の音声認識ソフトとして大々的に売り出されましたが、実際に認識できるのは特定の単語のみで、話し言葉を全文認識させるにはほど遠いものでした。

そのおよそ半年後、音声認識を使った3D育成シミュレーションゲーム『シーマン』(1999年、ビバリウム)が、ドリームキャスト向けに発売されました。コントローラにマイクデバイスを装着することでペットに直接話しかけられるゲームデザインが特徴で、人語を解する人面魚のシーマンはプレイヤーの年齢や性別、職業といった個人情報を次々と覚えていきます。

ちなみに当時は、シーマンの口の悪さや気難しい性格がやたら憎たらしいと話題になりました。これは音声認識における精度の低さをプレイヤー側に悟らせることなく、できるだけ短くはっきりと話しかける努力を無意識に仕向ける工夫だったと言われています。プレイヤーの言葉が上手く聞き取れずにへそを曲げてしまうシーマンを演出することで、音声認識の限界から生じる失敗の責任をユーザー側に転嫁するという革新的なデザインでした。

その後、2003年には音声認識を活用したPlayStation 2用アクションゲーム『オペレーターズサイド』(2003年、ソニー・コンピュータエンタテインメント)が登場します。コミュニケーションツールや育成ゲームといったそれまでのトレンドとは打って変わって、プレイヤーがオペレーターとなってヒロインのキャラクターに音声で指示を送ることで、移動・探索・戦闘のすべてをこなすアクション性が話題となりました。

しかし、短い単語を組み合わせた限定的な音声入力にしか対応できず、やはりプレイヤーがヒロインとの意思疎通に感情移入できるようなインターフェイスには至っていません。また、自然言語の認識率の低さは、迅速かつ的確な音声指示が要求される敵との戦闘状況において最大の足枷となり、ストレスを感じるプレイヤーは少なくなかったようです。

このほか、Xbox専用の美少女アンドロイド育成ゲーム『N.U.D.E.@ Natural Ultimate Digital Experiment』(2003年、マイクロソフト)や、ゲームキューブ向け人海戦術落城アクション『大玉』(2006年、任天堂)、PlayStation Portable専用の通訳ゲームソフト『TALKMAN』(2005年、ソニー・コンピュータエンタテインメント)など、2000年代には音声認識を活用したビデオゲームが複数登場しましたが、業界全体を巻き込むような技術革新には至りませんでした。

没入感の追求にはAIとの対話が不可欠

メタAIや自立型エージェントをはじめ、近年のゲーム業界ではAI技術がめざましい進化を遂げています。人々が没入感という新たな価値を追求していく上で、音声認識を活用したAIとのインタラクションに回帰することは自然な流れだといえるでしょう。そんな長らく停滞していたといっても過言ではない同分野を切り拓こうとしているのが、スクウェア・エニックスのテクノロジー推進部で自然言語処理によるAIとのコミュニケーションを研究するゴティエ・ボエダ氏です。

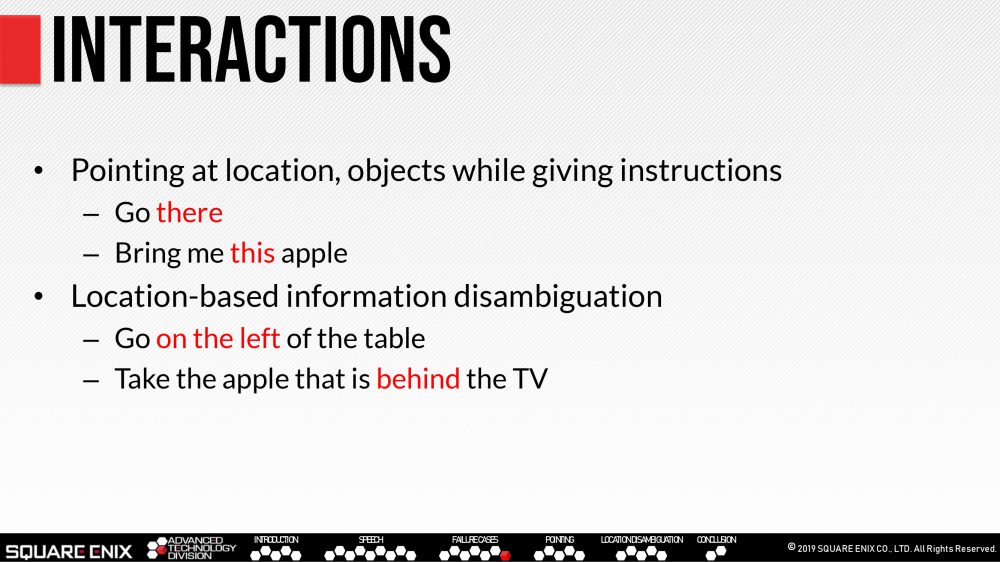

2019年3月にサンフランシスコで開催された「Game Developers Conference 2019」にて、ボエダ氏は「NPCs Have Feelings Too: Verbal Interactions with Emotional Character AI」と「Enhanced Immersivity: Using Speech Recognition for More Natural Player AI Interactions」というセッションに登壇。ゲームキャラクターとの自然言語コミュニケーションをとおして、特定状況下における問題解決を目指す音声認識技術のデモンストレーションを披露しました。その内容は、未知の惑星に墜落したプレイヤーが原住民である宇宙人に話しかけて、脱出用シャトルの修理を手伝ってもらうというもの。前述の『オペレーターズサイド』と同様に、プレイヤーは音声指示のみでタスクを完了しなければなりません。

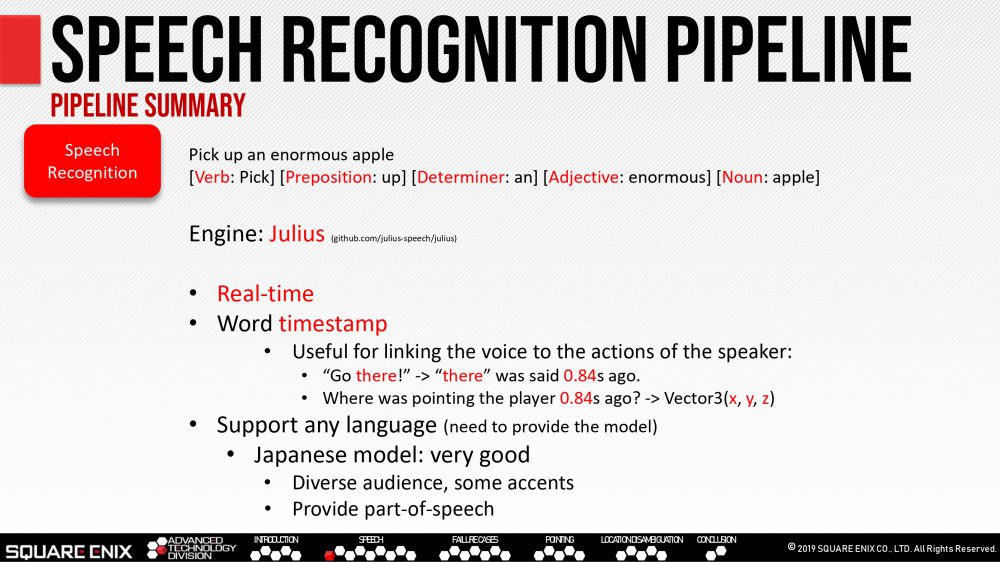

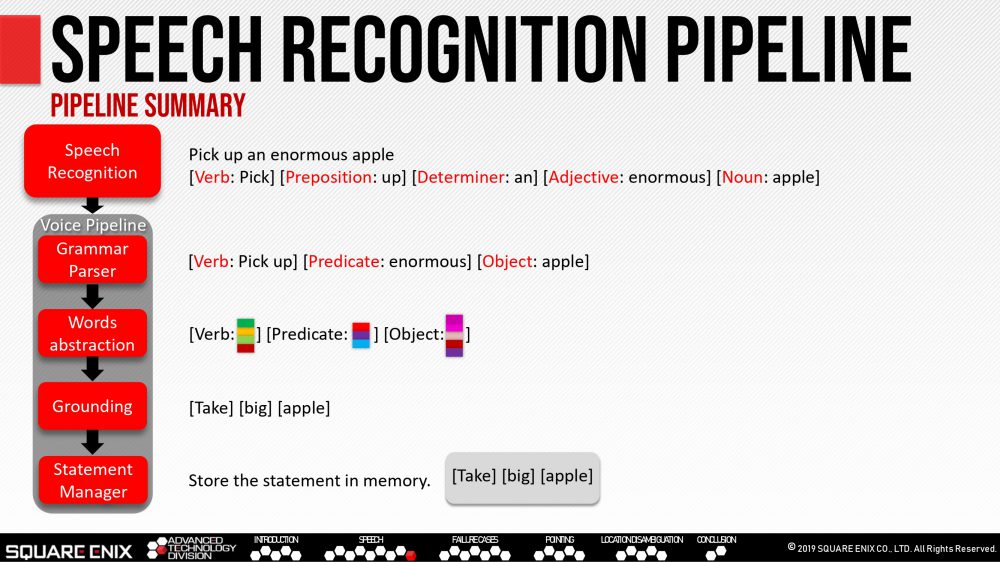

特定の単語や短い言葉の組み合わせにしか反応しなかった過去の音声認識ゲームと決定的に異なるのは、言語処理におけるパイプラインの設計です。通常、音声認識技術は人間の音声を特定の波形として認識することで環境音と区別し、その情報をテキストデータへと変換します。これを自然言語処理によって単語や文章として読み取り、情報要約にかけることで意味を構築していくのですが、ボエダ氏の技術デモではさらに言語の抽象化処理を担うパイプラインを設けています。

たとえば、「巨大なリンゴを拾ってくれ」とキャラクターに指示した場合、AIは「拾う」「巨大な」「リンゴ」といった具合に入力情報を動詞や修飾語、目的語に分解します。この際、「拾う」や「巨大な」という言葉を別の同義語へ自動的に変換することで、同じ意味でも言い回しの異なる自然言語の曖昧さに対応しています。この例の場合、AIは「大きなリンゴを取る」という文章として解釈します。このプロセスを抽象化パイプラインと呼びます。

この抽象化処理には、プリンストン大学の認知科学研究所が運営する概念辞書「WordNet」によって分類された同義語グループ「Synset」が使われています。また、自然言語のテキストデータ化には、オープンソースの音声認識エンジン「Julius」を採用しています。「Julius」は英語と日本語をふくめた多言語に対応しており、数万語彙の連続音声認識をリアルタイムで実行できる軽量さが特徴です。このエンジン側で対応言語を変更することで、ゲームシステムは複数言語の音声認識を同時に実現できます。

一連の音声認識プロセスの最大の利点は、プレイヤーが入力した言語情報に応じてゲームメカニクスの処理を変更するのではなく、入力情報を抽象化するパイプラインを経由させることによって、ゲームメカニクスの処理に沿ったインプットへと最適化できることです。これにより多言語のローカライズが容易になることはもちろん、プレイヤーは可能な限り自然な言葉遣いや言い回しでAIキャラクターと意思疎通できるようになります。

自然言語の曖昧さが生む障壁

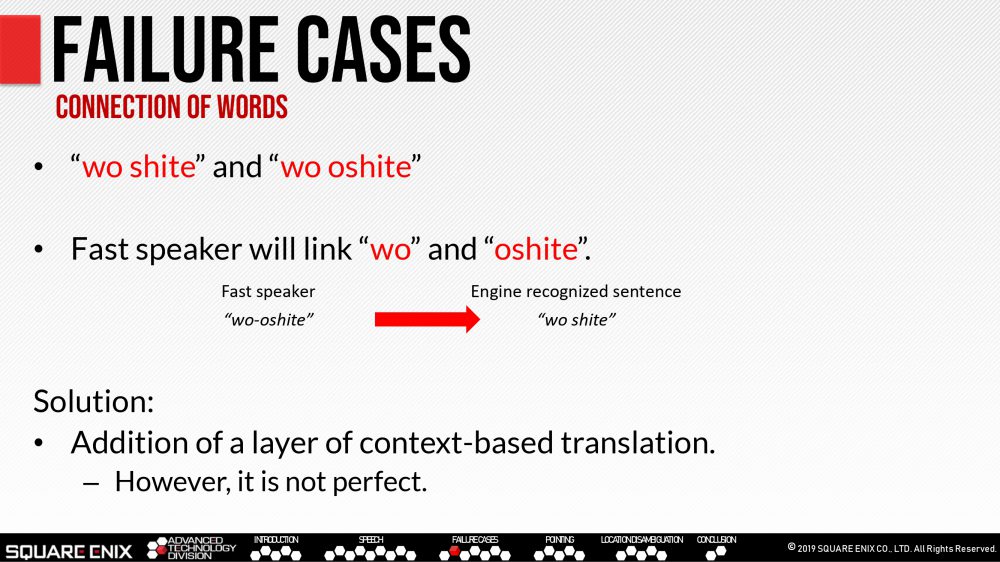

それでも言葉の曖昧さから生じる自然言語処理の課題は尽きません。日本語における一例として、音節の区切りによって音声情報が複数の意味に解釈されるケースが挙げられます。たとえば「これをして」という指示と「これ押して」という指示は、後者の助詞が抜けていることで音声データとしては完全に同じ波形と認識されてしまいます。当てはまる目的語によっては指示の内容をまったく理解できなくなってしまうでしょう。

このほか、「これ」「あれ」「そこ」といった抽象代名詞や、「(目的語)の後ろ」や「(目的語)の左側」などの相対的な位置情報も、自然言語処理における課題です。抽象代名詞に関しては、入力された単語のタイムスタンプを記憶することで、どの目的語を指しているかをある程度は特定できます。

相対的な位置情報については、オブジェクトの性質や観測者の視点によって事情が異なります。「テーブルの後ろ」といっても、大抵のテーブルには前も後ろもないため、ほかに情報がない場合はどこを指しているのかが曖昧になってしまいます。一方で「テレビの左」という場合には、例えば観測者がディスプレイ側を正面と認識しているのであれば、主観的にはどこを指しているのかが明確になります。

ただし、こうした位置情報の認識は、音声認識による自然言語処理のみならず、VRヘッドセットなどに搭載されているアイトラッキングによる視線情報などからも補完できるため、必ずしも大きな障壁にはならないといえるでしょう。

このように、最新の音声認識エンジンや膨大なデータベースからなる抽象化パイプラインを用いても、自然言語は曖昧さが残るため、AIがロジックの牢獄に囚われてしまうケースは後を絶ちません。そうした状況下では、どうしてもエージェント側が「お前は何を言っているんだ」という意思表示のフィードバックを生成する必要があります。20年前にプレイヤーを驚愕させたシーマンの悪態は、まさにこのフィードバックの役割を担っていたわけです。

今後、ゲームAIの研究・開発において自然言語処理の技術がさらに発展すれば、シーマンが一方的にプレイヤーの個人情報を収集しては哲学的なウンチクを垂れ流すだけでなく、毒舌の人面魚とラップバトルを繰り広げることも夢ではなくなるかもしれません。また、オペレーターとしてアクションゲームのヒロインを導く際にも、カーナビに話しかけているようなぎこちなさから虚無感が生まれることもなくなるかもしれません。さらには、ロールプレイングゲームで仲間のキャラクターに魔法やアイテムを使わせる際、わざわざキーボードやコントローラに指を伸ばさなくてもいい時代が来るのかもしれません。

Writer:Ritsuko Kawai

RANKING

RANKING