モリカトロン株式会社運営「エンターテインメント×AI」の最新情報をお届けするサイトです。

- TAG LIST

- CGCGへの扉生成AI安藤幸央吉本幸記月刊エンタメAIニュース河合律子機械学習ディープラーニングOpenAILLMGoogleNVIDIA大規模言語モデルグーグルGAN音楽モリカトロン森川幸人ChatGPT三宅陽一郎DeepMind強化学習Stable Diffusion人工知能学会ニューラルネットワークシナリオマイクロソフトQA自然言語処理AIと倫理GPT-3倫理Facebook大内孝子映画SIGGRAPHスクウェア・エニックス著作権アートキャラクターAIルールベースゲームプレイAIMinecraft敵対的生成ネットワークNPC音楽生成AI動画生成AIモリカトロンAIラボインタビューアニメーション3DCG画像生成NFTロボットファッションDALL-E2StyleGANプロシージャルディープフェイクマルチモーダルVFXMidjourney遺伝的アルゴリズムデバッグ自動生成VRメタAIMeta画像生成AIRed RamマンガインタビューゲームAIAdobeMicrosoftテストプレイマインクラフトCLIPテキスト画像生成深層学習CEDEC2019toio教育NeRFデジタルツインメタバース不完全情報ゲーム小説Stability AIボードゲームDALL-ESoraビヘイビア・ツリーCEDEC2021CEDEC2020作曲アストロノーカロボティクスナビゲーションAI高橋力斗AIアートGeminiメタ畳み込みニューラルネットワークアップルデジタルヒューマンELSIPlayable!スポーツエージェントGDC 2021プロンプトGPT-4手塚治虫汎用人工知能JSAI20223D広告DALL-E 3バーチャルヒューマンNVIDIA OmniverseGDC 2019マルチエージェントCEDEC2022市場分析AR懐ゲーから辿るゲームAI技術史鴫原盛之ジェネレーティブAIソニー東京大学はこだて未来大学栗原聡CNNマーケティングJSAI2024CMBERTMicrosoft Azure音声認識言霊の迷宮UnityOmniverseUbisoftJSAI2023Robloxがんばれ森川君2号電気通信大学SIGGRAPH ASIAHTNApple階層型タスクネットワークAIQVE ONE世界モデルアドベンチャーゲームインディーゲームJSAI2020GTC2023音声合成メタデータTensorFlowブロックチェーンイベントレポートキャリア模倣学習対話型エージェントAmazonサイバーエージェントトレーディングカードメディアアートDQNシーマン合成音声SIERunway水野勇太モリカトロン開発者インタビュー宮本茂則アバターブラック・ジャックGenvid TechnologiesガイスターStyleGAN2徳井直生稲葉通将斎藤由多加Open AIベリサーブGTC2022GPT-3.5YouTube音声生成AISFNetflixJSAI2021松木晋祐Bard研究シムシティシムピープルZorkGPT-4oMCS-AI動的連携モデルマーダーミステリーモーションキャプチャーTEZUKA2020CEDEC2023AGIテキスト生成スパーシャルAIElectronic ArtsGDC Summerイーロン・マスク論文Stable Diffusion XL森山和道Audio2FaceNVIDIA Rivaeスポーツスタンフォード大学アーケードゲームテニスセガ人狼知能Google I/O類家利直FireflyeSportsBLUE PROTOCOLCEDEC2024aibo大澤博隆SFプロトタイピング銭起揚Runway Gen-3 AlphaチャットボットTikToktext-to-3DDreamFusion自動運転車ワークショップEpic GamesAIロボ「迷キュー」に挑戦AWSAdobe MAX村井源クラウドAlphaZeroPreferred NetworksTransformerGPT-2rinnaAIりんなカメラ環世界中島秀之PaLMGitHub CopilotLLaMA哲学Apple Vision Proハリウッド宮路洋一Whisk理化学研究所Gen-1SIGGRAPH Asia 2024テキスト画像生成AI松尾豊人事データマイニングControlNet現代アートDARPA法律ドローンゲームエンジンUnreal EngineImagen人工生命バイアスサム・アルトマンVeoASBSぱいどんAI美空ひばり手塚眞デザインGDC 2025バンダイナムコ研究所ELYZANEDO建築ELIZAFSM-DNNMindAgentBIMLEFT 4 DEADくまうた通しプレイソニー・インタラクティブエンタテインメントOpenAI FiveMeshy本間翔太馬淵浩希Cygames岡島学ピクサー九州大学プラチナエッグイーサリアム効果音ボエダ・ゴティエビッグデータ中嶋謙互Amadeus Codeデータ分析自動翻訳MILENVIDIA ACEVeo 3ナラティブNianticOmniverse ReplicatorWCCFレコメンドシステムNVIDIA DRIVE SimWORLD CLUB Champion FootballNVIDIA Isaac SimSakana AI柏田知大軍事田邊雅彦トレカ慶應義塾大学Max CooperGPTDisneyPhotoshopPyTorch京都芸術大学ChatGPT4モンテカルロ木探索ByteDance眞鍋和子バンダイナムコスタジオコミコパヒストリアAI Frog Interactive新清士ラベル付け田中章愛ComfyUI齊藤陽介コナミデジタルエンタテインメント成沢理恵お知らせMagic Leap OneTencentサッカーバスケットボールLINEヤフーSuno AIKaKa CreationVOICEVOXtext-to-imageサルでもわかる人工知能VAETEZUKA2023DOOMリップシンキングRNNGameNGenグランツーリスモ・ソフィーUbisoft La Forgeスーパーマリオブラザーズ社員インタビュー知識表現ウォッチドッグス レギオンVTuberIGDA立教大学秋期GTC2022大阪公立大学HALOフォートナイトKLabどうぶつしょうぎジェイ・コウガミ音楽ストリーミングMIT野々下裕子Movie GenQosmoマシンラーニング5GMuZeroRival Peakpixivオムロン サイニックエックスGPTsセキュリティ対話エンジンポケモン3Dスキャン橋本敦史リトル・コンピュータ・ピープルCodexシーマン人工知能研究所コンピューティショナル・フォトグラフィーゴブレット・ゴブラーズ絵画3D Gaussian SplattingMicrosoft DesignerイラストシミュレーションSoul Machines柿沼太一完全情報ゲームバーチャルキャラクター坂本洋典宮本道人釜屋憲彦LLaMA 2ウェイポイントパス検索Hugging Face対談藤澤仁生物学XRGTC 2022xAI画像認識SiemensストライキStyleCLIPDeNAVoyager長谷洋平GDC 2024クラウドコンピューティングmasumi toyotaIBMぎゅわんぶらあ自己中心派OpenSeaGDC 2022Veo 2ウロチョロスSNSTextWorldEarth-2BingエコロジーMagentaソフトバンクSONYポケットモンスターELYZA PencilScenarioSIGGRAPH2023AIピカソGTC2021AI素材.comCycleGANテンセントAndreessen HorowitzQA Tech NightNetHack下田純也桑野範久キャラクターモーション音源分離NBAフェイクニュースユニバーサルミュージックRPGウィル・ライトWeb3SIGGRAPH 2022レベルデザインDreamerV3SIMAAIボイスアクター南カリフォルニア大学NVIDIA CanvasGDCGPUALifeオルタナティヴ・マシンサウンドスケープLaMDATRPGマジック:ザ・ギャザリングAI Dungeon介護BitSummitGemma 2Cube 3DゼビウスNetEaseInworld AIモリカトロンAIコネクトゲーム背景IEEEPoint-Eアパレル不気味の谷LoRAナビゲーションメッシュファインチューニング早稲田大学グランツーリスモ写真高橋ミレイ北野宏明深層強化学習松原仁松井俊浩武田英明フルコトモリカコミックパックマンELYZA DIGESTジョージア工科大学Apple IntelligenceWWDCWWDC 2024西成活裕ハイブリッドアーキテクチャAI野々村真LINE AIトークサジェストApex Legends群衆マネジメントライブポートレイトGTC2025NinjaコンピュータRPGライブビジネスWonder StudioAdobe Max 2023GPT-4-turboFuxi Labアップルタウン物語新型コロナ土木佐藤恵助Naraka:Bladepoint MobileKELDIC周済涛Bing Chat大道麻由バトルロイヤルメロディ言語清田陽司インフラBing Image Creator物語構造分析ビヘイビアツリーゲームTENTUPLAYサイバネティックス慶応義塾大学SoftServeMARVEL Future FightAstro人工知能史Amazon BedrockAssistant with Bard渡邉謙吾ALNAIRタイムラプスEgo4DAI哲学マップThe Arcadeここ掘れ!プッカAMRIバスキア星新一X.AISearch Generative ExperienceBLADE日経イノベーション・ラボStyleGAN-XLX Corp.Dynalang濱田直希GAGA敵対的強化学習StyleGAN3TwitterVLE-CE大柳裕⼠QUEEN階層型強化学習GOSU Data LabGANimatorXホールディングス加納基晴Runway Gen-4WANNGOSU Voice AssistantVoLux-GANMagiAI ActSkyReels竹内将SenpAI.GGProjected GANEU研究開発事例MobalyticsSelf-Distilled StyleGANSDXLArs Electronica赤羽進亮Stable Virtual CameraニューラルレンダリングRTFKTAI規制遊戯王IntangibleAWS SagemakerPLATONIKE欧州委員会UDI(Universal Duel Interface)ブライアン・イーノ映像セリア・ホデント形態素解析frame.ioClone X欧州議会第一工科大学EnoUXAWS LambdaFoodly村上隆欧州理事会佐竹空良Brain One誤字検出MusicLM小林篤史AlphaEvolve認知科学中川友紀子Digital MarkAudioLMContinuous Thought Machine(CTM)ゲームデザインSentencePieceアールティSnapchatMusicCaps荻野宏実ArmLUMINOUS ENGINEクリエイターコミュニティAudioCraft伊藤黎Stable Audio Open SmallLuminous ProductionsBlenderBot 3バーチャルペットビヘイビアブランチWord2Worldパターン・ランゲージ竹村也哉Meta AINVIDIA NeMo ServiceMubertWPPSTORY2GAMEちょまどマーク・ザッカーバーグヴァネッサ・ローザMubert RenderGeneral Computer Control(GCC)ウィットウォーターランド大学GOAPWACULVanessa A RosaGen-2Cradle森川の頭の中Adobe MAX 2021陶芸Runway AI Film FestivalSpiral.AI花森リドPlay.htPreVizItakoLLM-7bGoogle I/O 2025音声AI静岡大学AIライティングLiDARCharacter-LLM明治大学FlowOmniverse AvatarAIのべりすとPolycam復旦大学北原鉄朗Lyra 2FPSQuillBotdeforumChat-Haruhi-Suzumiya中村栄太MusicFX DJマルコフ決定過程NVIDIA MegatronCopysmith涼宮ハルヒ日本大学Animon.aiNVIDIA MerlinJasperハーベストEmu VideoヤマハツインズひなひまNVIDIA MetropolisForGames前澤陽Mayaパラメータ設計ゲームマーケットペリドット増田聡Deep Q-Learningバランス調整岡野翔太Dream Track採用AlphaGO協調フィルタリング郡山喜彦Music AI Toolsスペースインベーダーテキサス大学ジェフリー・ヒントンLyria科学史プリンス・オブ・ペルシャGoogle I/O 2023Yahoo!知恵袋AIサイエンティストドラゴンクエストIVAlphaDogfight TrialsAI Messenger VoicebotインタラクティブプロンプトAITerra堀井雄二エージェントシミュレーションOpenAI Codex武蔵野美術大学AI Overview山名学StarCraft IIHyperStyleBingAI石渡正人電通タイトーFuture of Life InstituteRendering with Style手塚プロダクションAICO2カプコンIntel林海象BitSummit DriftUbi AnvilエンジンLAIKADisneyリサーチヴィトゲンシュタイン古川善規V1 Video ModelRotomationGauGAN論理哲学論考Lightroom大規模再構成モデルOmega CrafterArtificial AnalysisGauGAN2CanvaLRMSPACE INVADIANSVideo Arenaドラゴンクエストライバルズ画像言語表現モデルObjaverse西島大介Video Model Leaderboard不確定ゲームSIGGRAPH ASIA 2021PromptBaseBOOTHMVImgNet吉田伸一郎Claude 3.5Dota 2ディズニーリサーチpixivFANBOXOne-2-3-45SIGGRAPH2024MistralMitsuba2バンダイナムコネクサス虎の穴3DガウシアンスプラッティングMotion-I2VJSAI2025ソーシャルゲームEmbeddingワイツマン科学研究所ユーザーレビューFantiaワンショット3D生成技術GTC2020CG衣装mimicとらのあなToonify3DNVIDIA MAXINEVRファッションBaidu集英社FGDC生成対向ネットワーク淡路滋ビデオ会議ArtflowERNIE-ViLG少年ジャンプ+Future Game Development Conference拡散モデルグリムノーツEponym古文書ComicCopilot佐々木瞬Diffusionゴティエ・ボエダ音声クローニング凸版印刷Gautier Boeda階層的クラスタリングGopherAI-OCRゲームマスターうめ画像判定Inowrld AI小沢高広Julius鑑定MODAniqueドリコムTPRGOxia PalusGhostwriter中村太一ai andバーチャル・ヒューマン・エージェントtoio SDK for UnityArt RecognitionSkyrimエグゼリオSaaSクーガー実況パワフルサッカースカイリムCopilotインサイト石井敦NHC 2021桃太郎電鉄RPGツクールMZカスタマーサポート茂谷保伯池田利夫桃鉄ChatGPT_APIMZserial experiments lainComfyUI-AdvancedLivePortraitGDMC新刊案内パワサカダンジョンズ&ドラゴンズAI lainGUIマーベル・シネマティック・ユニバースOracle RPGPCGMITメディアラボMCU岩倉宏介深津貴之PCGRLアベンジャーズPPOxVASynthDungeons&DragonsVideo to Videoマジック・リープDigital DomainMachine Learning Project CanvasLaser-NVビートルズiPhone 16MagendaMasquerade2.0国立情報学研究所ザ・ビートルズ: Get BackOpenAI o1ノンファンジブルトークンDDSPフェイシャルキャプチャー石川冬樹MERFDemucsAIスマートリンクスパコンAlibaba音楽編集ソフトシャープ里井大輝KaggleスーパーコンピュータVQRFAdobe Auditionウェアラブル山田暉松岡 聡nvdiffreciZotopeCE-LLMAssassin’s Creed OriginsAI会話ジェネレーターTSUBAME 1.0NeRFMeshingRX10Communication Edge-LLMSea of ThievesTSUBAME 2.0LERFMoisesGEMS COMPANYmonoAI technologyLSTMABCIマスタリングAIペットモリカトロンAIソリューション富岳レベルファイブYahoo!ニュース初音ミクOculusコード生成AISociety 5.0リアム・ギャラガーAI Comic Factory転移学習テストAlphaCode夏の電脳甲子園グライムスAI comic GeneratorBaldur's Gate 3Codeforces座談会BoomyComicsMaker.aiCandy Crush Saga自己増強型AIジョン・レジェンドGenie AILlamaGen.aiSIGGRAPH ASIA 2020COLMAPザ・ウィークエンドSIGGRAPH Asia 2023GAZAIADOPNVIDIA GET3DドレイクC·ASEFlame PlannerデバッギングBigGANGANverse3DFLARE動画ゲーム生成モデルMaterialGANダンスグランツーリスモSPORTAI絵師エッジワークスMagicAnimateReBeLUGC日本音楽作家団体協議会Animate AnyoneVirtuals ProtocolGTソフィーPGCFCAインテリジェントコンピュータ研究所VolvoFIAグランツーリスモチャンピオンシップVoiceboxアリババMarioVGGNovelAIさくらインターネットDreaMovingRival PrakDGX A100NovelAI DiffusionVISCUIT松原卓二ぷよぷよScratchArt Transfer 2ユービーアイソフトWebcam VTuberモーションデータスクラッチArt Selfie 2星新一賞ビスケットMusical Canvas北尾まどかポーズ推定TCGプログラミング教育The Forever Labyrinth将棋メタルギアソリッドVメッシュ生成Refik AnadolFSMメルセデス・ベンツQRコードVALL-EAlexander RebenMagic Leap囲碁Deepdub.aiRhizomatiksナップサック問題Live NationEpyllionデンソーAUDIOGENMolmo汎用言語モデルWeb3.0マシュー・ボールデンソーウェーブEvoke MusicPixMoAIOpsムーアの法則原昌宏AutoFoleyQwen2 72BSpotifyスマートコントラクト日本機械学会Colourlab.AiDepth ProReplica Studioロボティクス・メカトロニクス講演会ディズニーamuseChitrakarAdobe MAX 2022トヨタ自動車Largo.aiVARIETAS巡回セールスマン問題かんばん方式CinelyticAI面接官ジョルダン曲線メディアAdobe ResearchTaskadeキリンホールディングス政治Galacticaプロット生成Pika.art空間コンピューティングクラウドゲーミングAI Filmmaking AssistantDream Screen和田洋一リアリティ番組映像解析FastGANSynthIDStadiaジョンソン裕子4コママンガAI ScreenwriterFirefly Video ModelMILEsNightCafe東芝デジタルソリューションズ芥川賞Stable Video 4Dインタラクティブ・ストリーミングLuis RuizSATLYS 映像解析AI文学AI受託開発事例インタラクティブ・メディア恋愛田中志弥PFN 3D ScanElevenLabsタップルPlayable!3D東京工業大学HeyGenAbema TVPlayable!MobileLudo博報堂After EffectsNECAdobe MAX 2024ラップPFN 4D Scan絵本木村屋SneaksSIGGRAPH 2019ArtEmisZ世代DreamUp出版GPT StoreIllustratorAIラッパーシステムDeviantArtAmmaar Reshi生成AIチェッカーMeta Quest 3Waifu DiffusionStoriesユーザーローカルXR-ObjectsGROVERプラスリンクス ~キミと繋がる想い~元素法典StoryBird九段理江PeridotFAIRSTCNovel AIVersed東京都同情塔Orionチート検出Style Transfer ConversationProlificDreamer防犯オンラインカジノRCPUnity Sentis4Dオブジェクト生成モデルO2RealFlowRinna Character PlatformUnity MuseAlign Your GaussiansScam DetectioniPhoneCALACaleb WardAYGLive Threat DetectionDeep Fluids宮田龍MAV3D乗換NAVITIMEMeInGameAmelia清河幸子ファーウェイKaedimAIGraphブレイン・コンピュータ・インタフェース西中美和4D Gaussian Splatting3DFY.aiBCIGateboxアフォーダンス安野貴博4D-GSLuma AILearning from VideoANIMAKPaLM-SayCan斧田小夜GlazeAvaturn予期知能逢妻ヒカリWebGlazeBestatセコムNightShadeOasisユクスキュルバーチャル警備システムCode as PoliciesSpawningDecartカント損保ジャパンCaPHave I Been Trained?Dejaboom!CM3leonFortniteUnbounded上原利之Stable DoodleUnreal Editor For FortniteEtchedドラゴンクエストエージェントアーキテクチャアッパーグラウンドコリジョンチェックT2I-Adapter声優PAIROCTOPATH TRAVELERパブリシティ権西木康智Volumetrics日本俳優連合OCTOPATH TRAVELER 大陸の覇者山口情報芸術センター[YCAM]AIワールドジェネレーター日本芸能マネージメント事業者協会アルスエレクトロニカ2019品質保証YCAM日本マネジメント総合研究所Rosebud AI Gamemaker日本声優事業社協議会StyleRigAutodeskアンラーニング・ランゲージLayerIAPP逆転オセロニアBentley Systemsカイル・マクドナルドLily Hughes-RobinsonCharisma.aiTripo 2.0ワールドシミュレーターローレン・リー・マッカーシーColossal Cave AdventureMeta 3D Gen奥村エルネスト純いただきストリートH100鎖国[Walled Garden]プロジェクトAdventureGPT調査スマートシティ齋藤精一大森田不可止COBOLSIGGRAPH ASIA 2022リリー・ヒューズ=ロビンソンMeta Quest都市計画高橋智隆DGX H100VToonifyBabyAGIIP松本雄太ロボユニザナックDGX SuperPODControlVAEGPT-3.5 Turbo早瀬悠真泉幸典仁井谷正充変分オートエンコーダーカーリング強いAIGenie 2ロボコレ2019Instant NeRFフォトグラメトリウィンブルドン弱いAIWorld Labsartonomous回帰型ニューラルネットワークCybeverbitGANsDeepJoin戦術分析Third Dimension AIAzure Machine LearningAzure OpenAI Serviceパフォーマンス測定Lumiere東北大学意思決定モデル脱出ゲームDeepLIoTUNetGemini 2.0Hybrid Reward Architectureコミュニティ管理DeepL WriteProFitXImageFXSuper PhoenixWatsonxMusicFXProject MalmoオンラインゲームAthleticaTextFXフロンティアワークス気候変動コーチング機械翻訳Project Paidiaシンギュラリティ北見工業大学KeyframerSimplifiedProject Lookoutマックス・プランク気象研究所レイ・カーツワイル北見カーリングホールAI Voice over GeneratorWatch Forビョルン・スティーブンスヴァーナー・ヴィンジ画像解析Gemini 1.5AI Audio Enhancer気象モデルRunway ResearchじりつくんAI StudioエーアイLEFT ALIVE気象シミュレーションMake-A-VideoNTT SportictVertex AIAITalk長谷川誠ジミ・ヘンドリックス環境問題PhenakiAIカメラChat with RTXコエステーションBaby Xカート・コバーンDreamixSTADIUM TUBESlackロバート・ダウニー・Jr.エイミー・ワインハウスSDGsText-to-ImageモデルPixelllot S3Slack AIPlayStationPokémon Battle Scopeダフト・パンクメモリスタAIスマートコーチVRMLGlenn MarshallkanaeruTechno MagicThe Age of A.I.Story2Hallucination音声変換Latitude占いゴーストバスターズレコメンデーションJukeboxDreambooth行動ロジック生成AIスパイダーマンVeap Japanヤン・ルカンConvaiポリフォニー・デジタルEAPneoAIPerfusionNTTドコモ荒牧伸志SIFT福井千春DreamIconニューラル物理学EmemeProject SidDCGAN医療mign毛髪GenieAlteraMOBADANNCEメンタルケアstudiffuse荒牧英治汎用AIエージェントRobert Yangハーバード大学Edgar Handy中ザワヒデキAIファッションウィークRazer研修デューク大学大屋雄裕インフルエンサーProject AVA中川裕志Grok-1Streamlabsmynet.aiローグライクゲームAdreeseen HorowitzMixture-of-ExpertsIntelligent Streaming Assistant東京理科大学NVIDIA Avatar Cloud EngineMoEProject DIGITS人工音声NeurIPS 2021産業技術総合研究所Replica StudiosClaude 3スーパーコンピューターリザバーコンピューティングSmart NPCsClaude 3 Haikuエージェンテックプレイ動画ヒップホップ対話型AIモデルRoblox StudioClaude 3 SonnetAI Shorts詩ソニーマーケティングPromethean AIClaude 3 Opusテルアビブ大学サイレント映画もじぱnote森永乳業DiffUHaul環境音暗号通貨note AIアシスタントMusiioC2PATrailBlazerFUZZLEKetchupEndelゲーミフィケーションヴィクトリア大学ウェリントンAlterationAI NewsTomo Kiharazeroscope粒子群最適化法Art SelfiePlayfoolQNeRF進化差分法オープンワールドArt TransferSonar遊びカーネギーメロン大学群知能下川大樹AIFAPet PortraitsSonar+DtsukurunRALF高津芳希P2EBlob Opera地方創生グラフィック大石真史クリムトDolby Atmos吉田直樹メイクBEiTStyleGAN-NADASonar Music Festival素材CanvasDETRライゾマティクスProjectsSporeクリティックネットワーク真鍋大度OpenAI JapanDeepSeekデノイズUnity for Industryアクターネットワーク花井裕也Voice EngineDeepSeek-R1画像処理DMLabRitchie HawtinCommand R+SentropyGLIDEControl SuiteErica SynthOracle Cloud InfrastructureLoopyCPUDiscordAvatarCLIPAtari 100kUfuk Barış MutluGoogle WorkspaceリップシンクSynthetic DataAtari 200MJapanese InstructBLIP AlphaUdioCyberHostCALMYann LeCun日本新聞協会立命館大学OmniHuman-1プログラミング鈴木雅大AIいらすとや京都精華大学CSAMソースコード生成コンセプトアートAI PicassoTacticAIImagen 3GMAIシチズンデベロッパーSonanticColie WertzEmposyNPMPGoogle LabsGitHubCohereリドリー・スコットAIタレントFOOHMicrosoft MuseウィザードリィMCN-AI連携モデル絵コンテAIタレントエージェンシーゲーム生成モデルUrzas.aiストーリーボードmodi.aiProject AstraWHAMデモンストレーター大阪大学Google I/O 2024ChatGPT Edu西川善司並木幸介KikiBlenderBitSummit Let’s Go!!滋賀大学サムライスピリッツ森寅嘉Zoetic AISIGGRAPH 2021ペット感情認識キリンビールストリートファイター半導体Digital Dream LabsPaLM APIデジタルレプリカ音声加工桜AIカメラTopaz Video Enhance AICozmoMakerSuiteGOT7マルタ大学Solist-AIDLSSタカラトミーSkebsynthesia田中達大ローム山野辺一記LOVOTDreambooth-Stable-DiffusionHumanRF大里飛鳥DynamixyzMOFLINActors-HQMove AIベンチマークRomiGoogle EarthSAG-AFTRAICRA2024FactorioU-NetミクシィGEPPETTO AIWGAHao AI Lab13フェイズ構造ユニロボットStable Diffusion web UIチャーリー・ブルッカー大規模基盤モデルカリフォルニア大学ADVユニボToroboGamingAgentXLandGato岡野原大輔東京ロボティクスClaudeAI model自己教師あり学習インピーダンス制御AnthropicDEATH STRANDINGAI ModelsIn-Context Learning(ICL)深層予測学習Claude 3.7 SonnetEric Johnson汎用強化学習AIZMO.AI日立製作所Factorio Learning EnvironmentMOBBY’SFLEOculus Questコジマプロダクションロンドン芸術大学モビーディック尾形哲也Deepseek-v3生体情報デシマエンジンGoogle Brainダイビング量子コンピュータAIRECGemini-2-FlashSound Controlアウトドアqubit汎用ロボットLlama-3.3-70BSYNTH SUPERAIスキャニングIBM Quantum System 2オムロンサイニックエックスGPT-4o-Mini照明Maxim PeterKarl Sims自動採寸ViLaInJoshua RomoffArtnome3DLOOKダリオ・ヒルPDDLZOZO NEXTハイパースケープICONATESizerジェン・スン・フアンニューサウスウェールズ大学ZOZO山崎陽斗ワコールHuggingFaceClaude SammutFashion Intelligence System立木創太スニーカーStable Audioオックスフォード大学Partial Visual-Semantic Embedding浜中雅俊UNSTREET宗教Lars KunzeWEARミライ小町Newelse仏教杉浦孔明GPT-4Vテスラ福井健策CheckGoodsコカ・コーラ田向権ソイル大学GameGAN二次流通食品VASA-1Tesla Bot中古市場Coca‑Cola Y3000 Zero SugarVoxCeleb2AIパズルジェネレーターTesla AI DayWikipediaDupe KillerCopilot Copyright CommitmentAniTalkerDolphinGemmaソサエティ5.0Sphere偽ブランドテラバース上海大学SIGGRAPH 2020バズグラフXaver 1000配信京都大学Wild Dolphin Projectニュースタンテキ養蜂立福寛SoundStreamトークナイザー東芝Beewiseソニー・ピクチャーズ アニメーション音声解析音声処理技術DIB-R倉田宜典フィンテック感情分析LumaGPT-4.1投資Fosters+Partners周 済涛Dream MachineGPT-4.1 mini韻律射影MILIZEZaha Hadid ArchitectsステートマシンNTTGPT-4.1 nano韻律転移三菱UFJ信託銀行ディープニューラルネットワークPerplexityLINE AI

【CEDEC2022】AIでモーションスタイル変換〜バンダイナムコ研究所の取り組み〜

バーチャルなキャラクターの活用の場はゲームやアニメのみに留まらず、いまや動画配信やバーチャル空間のアバターなど、キャラクタービジネスの可能性は多方面へと広がっています。一方で、キャラクターの作り込みには経験やスキルが必要です。バンダイナムコ研究所では、AIを使った人型キャラクターのモーションデータの利活用について研究開発が進められています。CEDEC2022のセッション「モーションキャプチャデータを題材にしたAI研究プロジェクトのポストモーテム – データセット構築からモーションスタイル変換プロジェクトまで」ではバンダイナムコ研究所の髙橋誠史氏、森本直彦氏、株式会社ACESの小林真輝人氏が登壇し、この取り組みを紹介しました。

モーションデータ×AIの潜在ニーズ

バンダイナムコグループのR&Dを担うバンダイナムコ研究所は、ゲーム制作へのAI技術の応用というところで、これまでテキスト(シナリオ、セリフ)、音声(ボイス、効果音、BGM)を対象とした研究を行っています。次の研究開発の対象として着目したのがモーションデータです。とはいえ、ゲームにおけるモーションデータの制作シーンを考えたときにどのような課題があるでしょうか。AIを使うことで何ができるか、どう貢献できるのかを検討するところから始めました。

モーションデータはキャラクターの表現にとって非常に重要な要素です。主役級のキャラクターであれば、モーションアクターをキャスティングして何時間も収録するなどコストをかけて作っていきます。ただし、すべてのキャラクターにそうできるわけではありません。モブ的なキャラクターが大勢、それも老若男女が出てくるとき、そのすべてを収録でカバーすることはまずできません。もし、AIの導入でモーションデータの変換が容易にできれば、ゲームとしての表現が格段に上がるでしょう。

もちろんゲームだけではなく、メタバースの中のアバターにも活用できます。ビジュアルで個性を表現できるようになっていても、動き(モーション)まではカスタマイズが難しいというのが現状です。ちょっとした仕草や動き、そこにも個性を出したいと思う人は多いはずです。あるいは、演者の属性と異なるアバターを演じたいという場合、たとえば男性が美少女のアバターを使って配信するとき、リアルな素の動作を可愛いらしくしたいと思うことがあるでしょう。このように、キャラクターの個性を表現する用途において大きなニーズがあると考えられます。

また、たとえば踊りやパフォーマンスがテーマのゲームなどで、キャラクターが徐々に上手になる過程を描きたいとき、最初は下手に見せたいということがあるでしょう。ボイスチェンジャーのようにモーションの変換ができれば、このようなニーズにも応えることができます。

ニーズがありそうだということで、モーションデータを扱う先行研究を「キャラクターコントロールに関するもの」「モーションをスタイル変換するもの」「自然言語処理によるモーション生成」に分けて調べていきました。

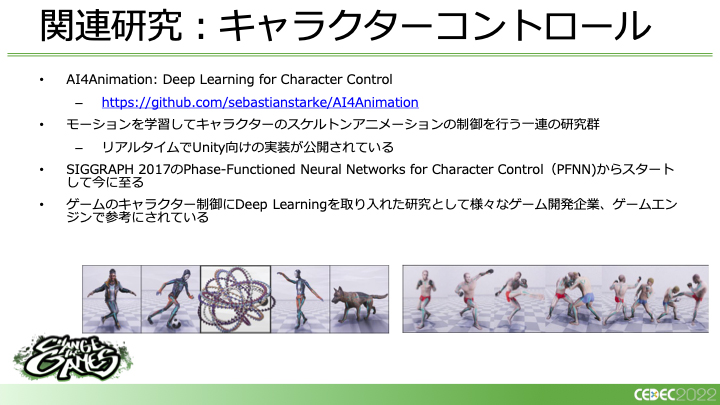

まず、キャラクターコントロールに関する関連研究として、「AI4Animation: Deep Learning for Character Control」が挙げられます。SIGGRAPH 2017で発表された「Phase-Functioned Neural Networks for Character Control(PFNN)」からスタートした一連の研究群です。モーションを学習したモデルからキャラクターのスケルトンアニメーションの制御を行うというもので、ゲームのキャラクター制御にディープラーニングを取り入れたエポックメイキングな研究として知られています。

他にも、GDC 2022のAnimation SummitでElectronic Artsが発表した「’FIFA 22’s’ Hypermotion: Full-Match Mocap Driving Machine Learning Technology」があります。サッカーゲームの選手キャラクターのモーションを機械学習で生成しようという研究で、収録したデータを学習して、ボールに対する選手のインタラクションなどのモーション選定を機械学習で推論するというものです。サッカースタジアムで、実際のゲームの形式でデータを収集するという大規模なプロジェクトです。

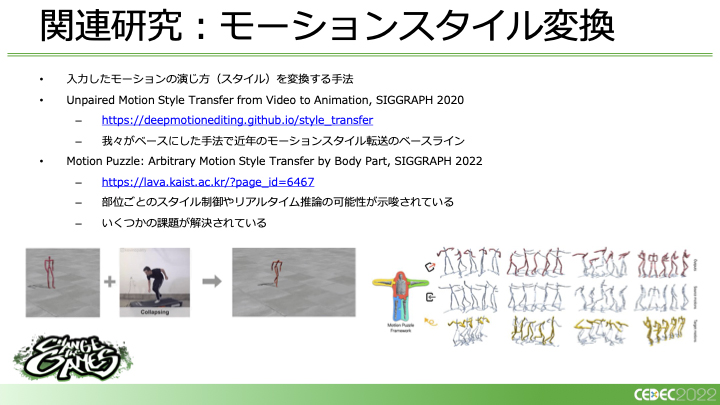

次に、モーションをスタイル変換するというカテゴリーです。これは、「歩く」「走る」というモーションに対し、後から「おじいさんの動き」「小さな子どもの動き」というような演技スタイルを加えることで、異なる演技スタイルに変えるというジャンルです。これに関して注目しているものとして2つの研究を取り上げました。

1つが「Unpaired Motion Style Transfer from Video to Animation」です。SIGGRAPH 2020で発表されたもので、現在のAIによるモーションスタイル変換のベースになってる研究です。もう1つが「Motion Puzzle: Arbitrary Motion Style Transfer by Body Part」で、これはUnpaired Motion Style Transferを手や足など部位ごとに適応させるという後続の研究です。2022年の3月に論文が出て、SIGGRAPH 2022で発表されました。

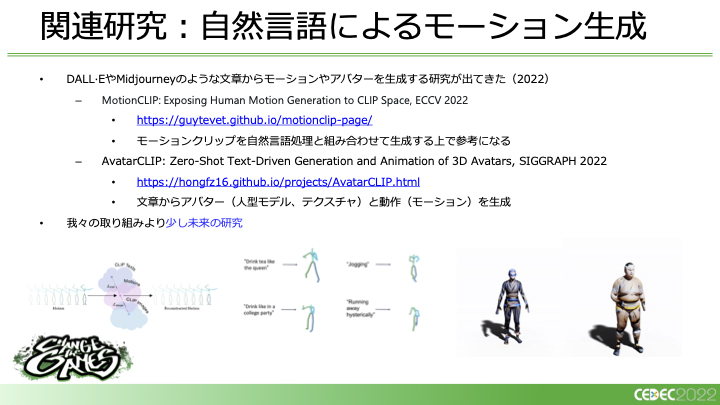

そして、自然言語処理によるモーション生成の先行研究として、「MotionCLIP: Exposing Human Motion Generation to CLIP Space」、「AvatarCLIP: Zero-Shot Text-Driven Generation and Animation of 3D Avatars」が紹介されました。巷でもDALL・EやMidjourneyのように、文章を入れたら絵が生成されるAIモデルが流行っていますが、それと同じように、文章をもとにアクションやモーションを生成する研究です。

MotionCLIPはテキストとモーション生成の関係性についての研究で、一方、AvatarCLIPは動作だけでなく、人型のキャラクターに貼り付けるテクスチャー、体型なども文章から生成するというものです。

この分野は今回の取り組みよりも少し先の未来の話だとしながらも、もちろん研究としては視野に入れていると言います。髙橋誠史氏(以下、髙橋氏)は「文章を入れたらいい感じのモーションが生成される」というモデルの実用化まで、あと2、3年というところではないかと言います。

こうした先行研究をサーベイしながら、多数のキャラクター、個性的なメタバースアバターへの長期的な活用につながるということで、モーションスタイル変換の研究を進めていくことになります。実際のゲームに組み込むというより、まずは「データを入れてデータが出てくる」という部分で考えていきました。

今回のプロジェクトの座組みに当たって、「CG」「モーションアニメーション」「AI」の3つの領域の専門家が必要です。内部リソースの稼働の問題もあり、株式会社ACEに協力を依頼するという体制でスタートしました。

モーションスタイル変換とは

では、モーションスタイル変換で何ができるようになるのでしょうか。モーションスタイル変換の技術についてはACEの小林真輝人氏(以下、小林氏)から解説がありました。ACEは2017年創業の東京大学松尾研発のAIスタートアップで、以前からカメラ映像を使った運動認識のAI開発に取り組んでいます。

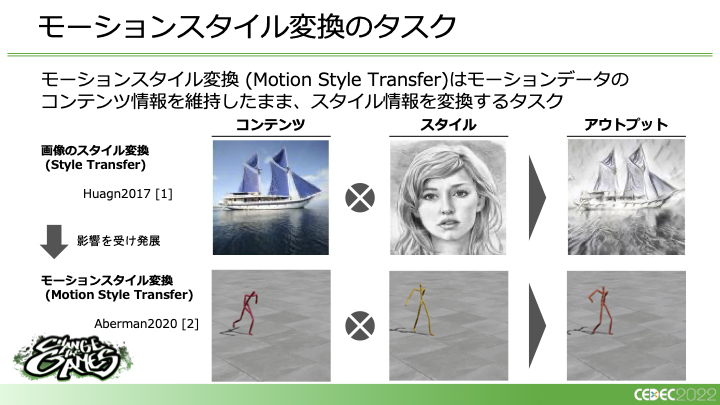

小林氏は、まず「モーションスタイルの変換(Motion Style Transfer)」というタスクについて、もともとは画像のスタイルトランスファー(Style Transfer)のモーション版にしたものだと言います。つまり、もともとのモーションのコンテンツの情報を維持したままスタイルの情報を変換した新しいモーションを生成するタスクということになります。

画像の場合、たとえば船の画像であれば「船が写っている」というところがコンテンツに当たります。それに対しスタイルは画風のようなもので、スタイルトランスファーというタスクのアウトプットは「コンテンツとスタイルを掛け合わせたトランスファーの結果」です。

モーションの場合は、たとえば歩いているというような「何をしているか」という情報がコンテンツで、スタイルは「どのように歩いているか」という情報になり、アウトプットは「そのスタイルを反映させて歩いているというモーション」になります。より具体的には、属性(年齢や性別など)や性格によるキャラクターの”らしさ”やキャラクターの感情、状態(「元気だ」とか「疲れている」とか)というような情報が具体的なモーションにおけるスタイルに該当します。

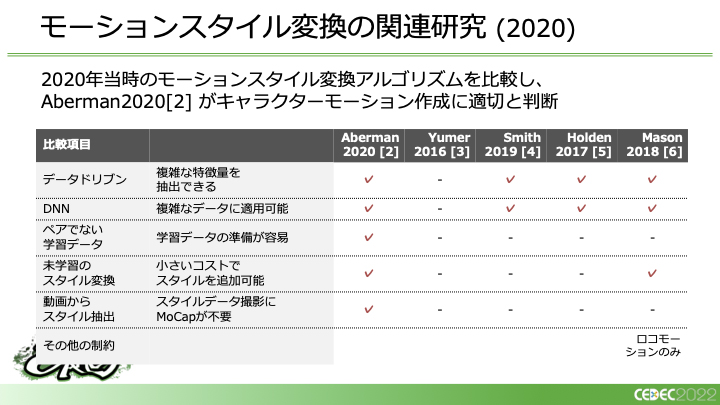

今回、いくつかあるモーションスタイル変換に関する関連研究の中から、Abermanの2020年の論文をベースとして進めることにしました。小林氏は、2020年時点での比較とした上で、Abermanの論文の優れている点として、ペアではない学習データでも学習が可能であるという点、また学習データセットにふくまれていない未学習のスタイルに変換できる点、動画からそのままスタイルが抽出できるといった点を挙げています。それらの利点が、この「キャラクターのモーションの作成」という目的に適切であると考えたのです。

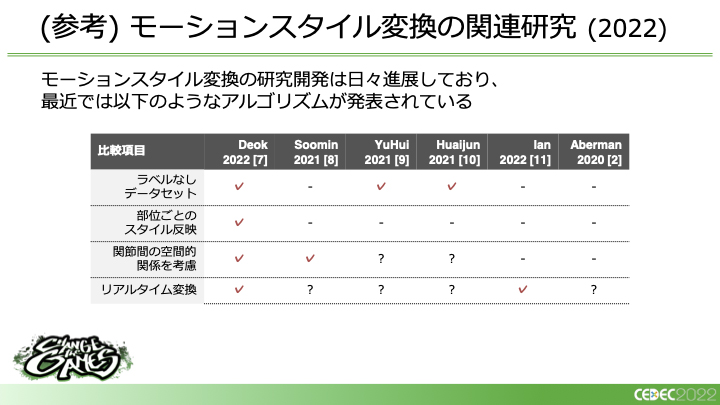

2022年の現在、モーションスタイル変換はさらに研究が進んでおり、前述のMotion Puzzleのように部位ごとにスタイルが反映できたり、関節間の空間的な関係を考慮した変換ができるといったようなところも進んでいるといいます。

独自の改善点:ボーン構造の変更とROOT位置

Abermanの2020年の論文をベースにはしていますが、独自の改善をかなり行っています。

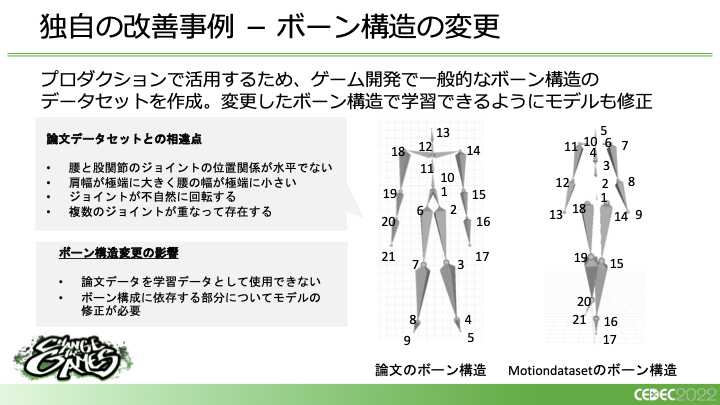

たとえば、ボーン構造の変更です。理由として、アカデミアの研究開発で使われているボーン構造と一般的なゲーム開発などで用いられるボーン構造が異なるということがあります。図の左がもともとの論文で使われているボーン構造で、右がこのプロジェクト内で収録したデータセットで使っているボーン構造です。

そもそものプロポーションが違っているし、腰と股関節のジョイントの位置関係や複数のジョイントが重なって存在したり、回転の定義の仕方などの相違点が多々あります。このまま現在のゲーム開発で使われているボーンにこの左側のボーンで作られたモーションを適用するのは難しいということで、今回、一般的なゲーム開発で用いられているボーン構造で学習データを用意することになりました。学習データだけではなく、変更したボーン構造で学習できるようモデル側の修正も必要でした。

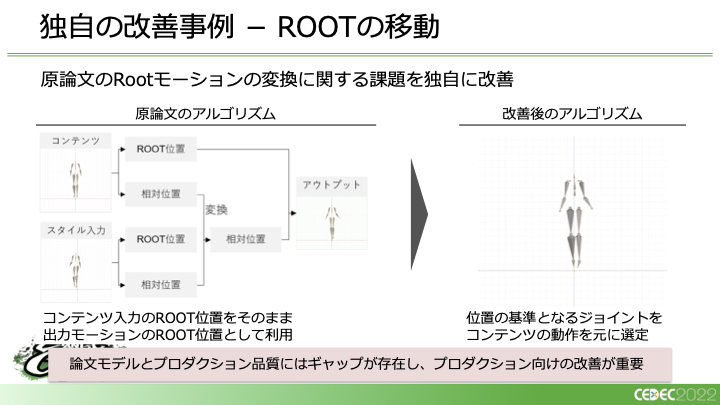

また、アルゴリズムの調整も行っています。もともとの論文では、腰を基準にジョイントの位置情報を取得してモーションスタイルの変換を行います。このとき、腰の位置は入力時のROOTの位置をそのまま適用しています。しかし、そうすると腰の動きに関してスタイルの反映ができないということになります。そこで、位置の基準となるジョイントをコンテンツの動作を元に選定するというアプローチを採りました。

モーションスタイルの変換例

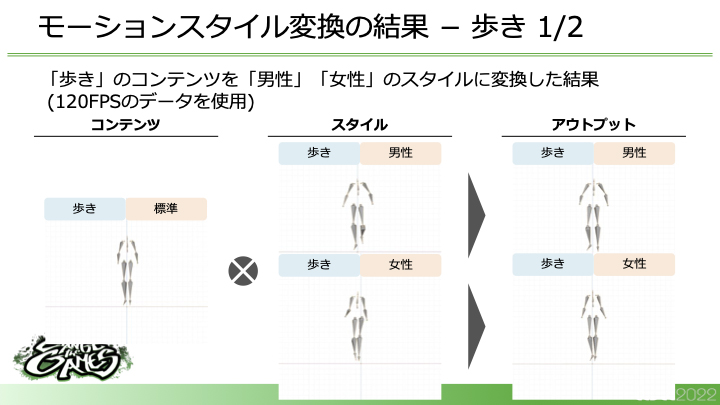

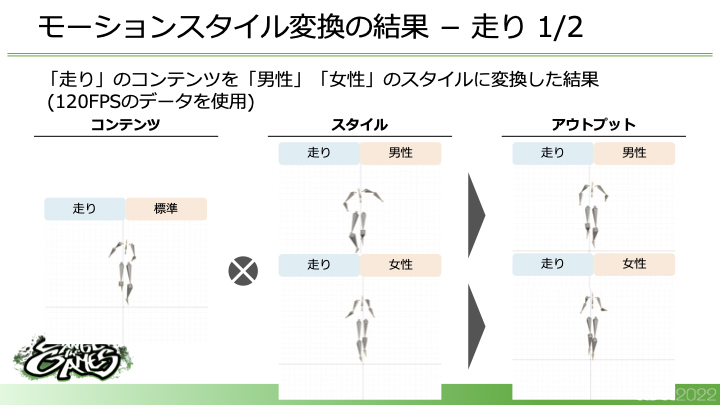

実際に変換した結果は、というと、次の図は「歩き」というコンテンツを男性から女性のスタイルに変換したものです。このように、各スタイルが反映され、かつ、歩いているというコンテンツが維持されたモーションが出力できます。

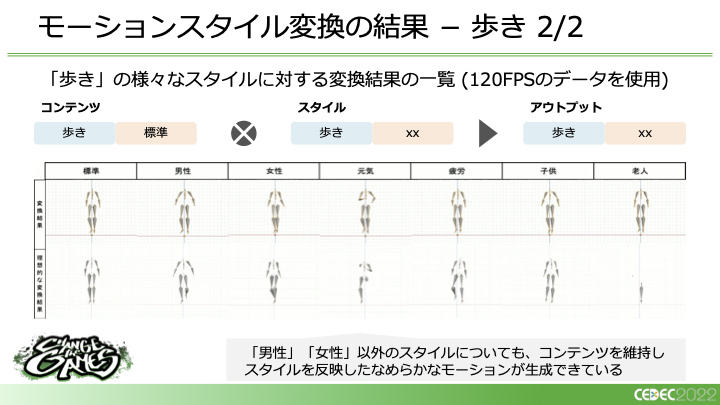

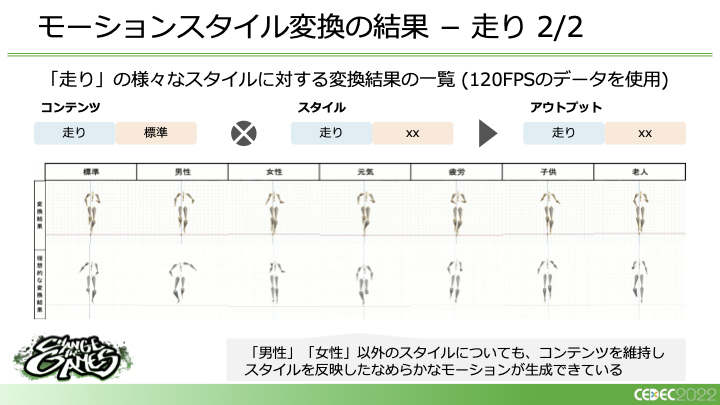

さらに、「元気」「疲労」「子供」「老人」というスタイルに関しても、コンテンツを維持してスタイルを反映したなめらかなモーションが生成できます。

また、「走り」という動作に関してもコンテンツを維持してスタイルを反映した、なめらかなモーションが生成できています。「走り」は「歩き」に比べるとモーションが激しいため、難易度的には少し上がります。

3Dアニメーターがプロジェクトにいる意味

でき上がったモーションや研究開発の過程におけるモーションデータに関するディレクションを監修していたのが、株式会社バンダイナムコ研究所の森本直彦氏(以下、森本氏)です。

森本氏は、バンダイナムコスタジオで長く3Dアニメーターとしてゲーム制作に携わり、現在バンダイナムコ研究所にてアニメーションに関わるR&Dを行っています。まず、今回のプロジェクトにおいて、アニメーションの専門家として3つの役割があったと振り返ります。

- データセット構築のためのモーションキャプチャーに関するすべて:モーションキャプチャーは特殊な分野のため、スケジューリングやキャスティング、収録の進め方など、すべてを担当

- プロジェクト全体を通じて、アウトプットされた結果そのものの品質をある程度見極める:現状のAI研究はそれぞれ非常に興味深い成果を出しているが、実際に商品にしようとしたときに求められる完成度とは別。ときに非常に厳しい意見をフィードバックとして出すことも多々あった

- 専門家としての視点からの気付きやアドバイス:「動き」という点だけに着目してきた長年のアニメーターとしての経験からの知見や気付きをフィードバックする

森本氏は、特にデータセットへの落とし込み(モーションの収録)という点で、今回のプロジェクトで痛感したのは圧倒的なデータ量が必要となるというところだったと言います。手探りで進めていたこともあるとはいえ、たとえば1つのモーション(「歩き」や「走り」など)に対し、スタイルを掛け算していくとすぐに100モーションというような数字になってしまいます。1モーションが5分だとすると100モーションで500分、まともに収録すると収録日数もふくめたモーションキャプチャの費用だけで何千万円という途方もない金額になります。とても研究予算の中に収まりません。

そのため、AIのエンジニアと相談しながら、本当に必要な内容を残しつつ、全体の収録量を現実的なラインに落とし込んでいったそうです。データセットについては次項でも触れますが、データセットを設計する際の気づきとして指摘したのが「モーション(動作そのもの)とアニメーションを意識的に分けて考える」ことです。

たとえば「手を挙げる」動作はモーションです。それに対して、その動作に目的をふくめて表現したものがアニメーションだという考え方です。人間が「手を挙げる」のは遠くにいる人への挨拶であったり、あるいは意見があることを示したい場合だったり、その動作には目的があるわけです。

アニメーターにとっては動作そのものよりもその目的のほうが重要で、動作は目的に付随したものという位置づけです。そういった目的のほうに着目して動きをイメージしたり表現したりということを無意識にしがちなのですが、一方で、AIは学習する際にその動きの意味や目的は認識していません。AIはあくまで動作そのものしか見ないので、AIに学習させる内容を検討する際には人間の側も意識的に動作のほうに着目して考えるようにしなければ、なかなかAIに学習させやすいデータセットは作れないのではないかと言います。

これは非常に興味深い観点で、目的が異なっても同じ「動作」にカテゴライズできるものはあるわけで、そういった整理を事前にしっかりしておくことでノイズの少ない、学習しやすいデータセットを作ることができるのではないかということです。

また、演者(モーションアクター)の難易度が非常に高いというところも留意点として挙げています。ゲームのモーション収録では、せいぜい数百秒の収録です。しかし前述のように、AIが学習するためのデータセットに必要な収録は数時間、場合によっては数十時間かかります。アクターにとっては体力勝負になります。

さらに、ただ動けばいいわけではなくて、スタイルを学習させるためのデータなので、常にスタイルの違いなどを反映した質の高い動きを保ってもらう必要があります。実際、今回のプロジェクトではアクターとして非常に高いスキルを持つ演者に依頼したそうです。ちなみに、収録はバンダイナムコスタジオのモーションキャプチャスタジオで行っています(Viconの光学式モーションキャプチャシステムで収録)。

データセットの設計について

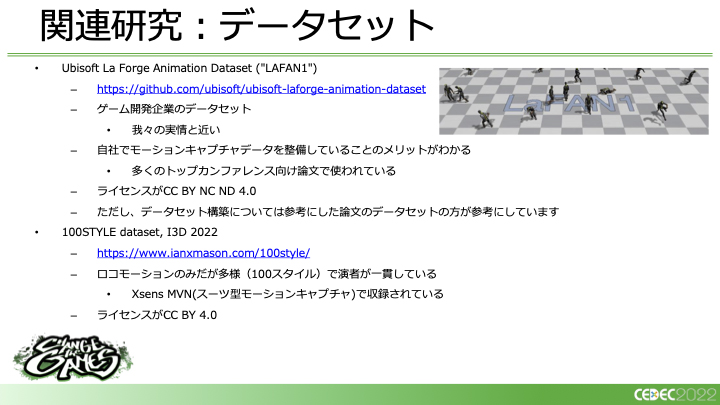

データセットの設計に関する先行研究として参考にしたものとして「Ubisoft La Forge Animation Dataset(”LAFAN1″)」や「100STYLE dataset, I3D 2022」があります。

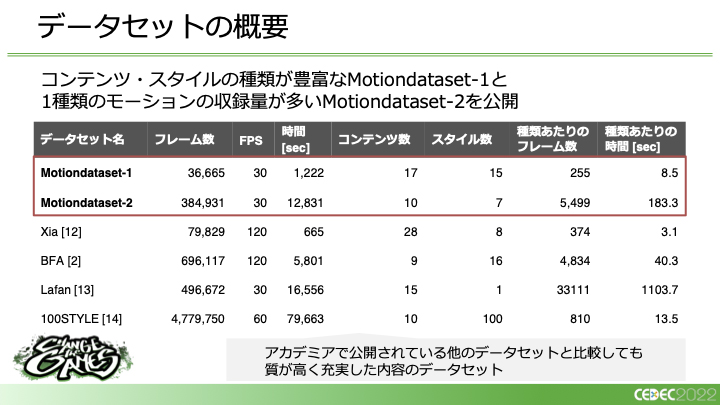

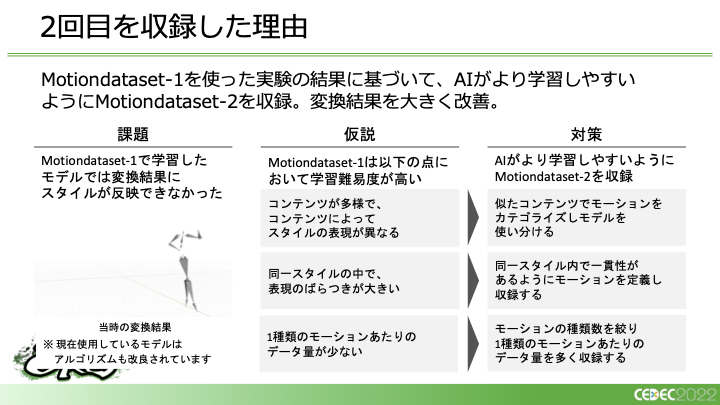

データセットの概要としては、次の図のとおりです。コンテンツやスタイルの種類が豊富なMotiondataset-1と1種類のモーションの収録量が多いMotiondataset-2があります。大きな違いは、Motiondataset-2のほうが1種類あたりのフレーム数が圧倒的に多いという点です。Motiondataset-1とMotiondataset-2があるのは収録を2回行っているからです。要は、Motiondataset-1を使った実験の結果に基づいて、AIがより学習しやすいようにMotiondataset-2を収録した、ということになります。

たとえば「歩く」×「悲しい」と「歩く」×「楽しい」で生成した結果どちらも同じようになってしまう、そうした点を反映するために、同一スタイルの中の表現のばらつきを解消する、1種類あたりのデータ量を多くするなどして収録を行いました。

また、変換に使っているモデルのアルゴリズムの部分も改良し、学習難易度を下げるために似たようなコンテンツでカテゴライズし、モデルを使い分けるという形にしています。その結果、アウトプットの質も大きく改善したと言います。

モーションデータのデータセットを設計する上で、今後の課題として高橋氏が指摘するのは、データのラベリングやアノテーションの仕方といった部分です。今回のデータセットに関しては「歩く」「走る」というようなアクションそのもののコンテキストと、男性女性老人若者というようなスタイルをファイル名に入れるという命名規則で十分でしたが、より複雑な処理をしようとした場合、ラベリングやアノテーションの仕方が課題になってくると考えています。

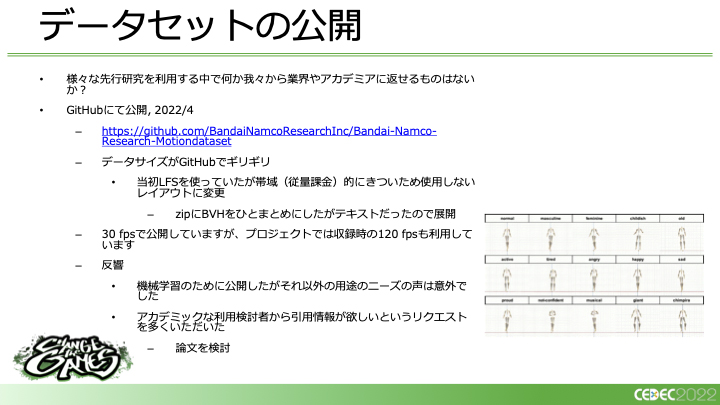

バンダイナムコ研究所では、今回のプロジェクトで使用したデータセットを公開しています。 モーション変換アルゴリズムだけでなく、こうしたさまざまな先行研究を利用する中で、自分たちも何か業界やアカデミアに返せるものがないかということで、今回、データセットの公開を行ったそうです。

今回のプロジェクトはデータセットを公開したところが終了ではなく、この後、これを活用していくというところが自分たちの技術開発において礎になると考えています。今、文章から絵を自動生成するAIモデルが世の中を席巻していますが、これはモーションの世界でも起こるでしょう。そうしたとき、ツールの形で利用するのか、自分たちでモーションデータを収録して研究開発するのか、2つの選択肢があるが、どちらにしてもアンテナを張っておくという意味でこうした研究開発の意味は大きいと高橋氏は言います。

今後も、こうしたチャレンジを続けて、データセットの更新や論文化を進めていく予定です。

Writer:大内孝子

RANKING

RANKING